Jika anda hendak meningkatkan kualitas SEO Website anda, maka robots.txt adalah faktor yang sangat perlu dibahas. Jadi, robots.txt, mengapa menjadi faktor yang sangat penting, dan bagaimana kita bisa mengoptimalkan file robots.txt pada WordPress untuk SEO friendly? Jika Anda tidak mengerti maka anda dapat membaca artikel ini, karena saya akan mencoba menerangkannya pada anda.

Jika anda hendak meningkatkan kualitas SEO Website anda, maka robots.txt adalah faktor yang sangat perlu dibahas. Jadi, robots.txt, mengapa menjadi faktor yang sangat penting, dan bagaimana kita bisa mengoptimalkan file robots.txt pada WordPress untuk SEO friendly? Jika Anda tidak mengerti maka anda dapat membaca artikel ini, karena saya akan mencoba menerangkannya pada anda.

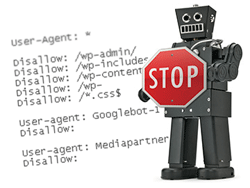

APA ITU ROBOTS.TXT?

Robots.txt merupakan file teks sederhana yang akan mengontrol bagaimana mesin pencari harus berperilaku pada situs web Anda. Inilah item yang akan mengarahkan mesin pencari untuk mengindeks dan di mana mereka tidak diizinkan mengindeks. Ketika robot mesin pencari sedang melakukan perayapan ke dalam website Anda, Mesin pencari akan terlebih dahulu mengikuti perintah dari robots.txt yang ada.

Secara standar, search engine telah dirancang untuk mengindeks informasi sebanyak yang mereka dapatkan dan robots.txt dapat membatasi info tersebut. Anda mungkin bertanya-tanya dalam benak, mengapa harus membatasi mesin pencari memperoleh informasi lebih yang ada, bukankan dengan begitu website kita lebih berpelung untuk tampil ?

Secara total, terdapat dua alasan untuk memakai file ini. Pertama, Jika kita membuka semua data untuk diakses mesin pencari, maka situs anda akan rentan dan sangat mudah untuk di-hack orang. yang Kedua, memungkinkan mesin pencari untuk bisa mengakses situs anda unrestrictedly, bisa mengkonsumsi bandwidth yang besar; dan sebagai efeknya, situs anda akan menjadi lambat.

BAGAIMANA CARA MENGOPTIMALKAN WORDPRESS SEO DENGAN ROBOTS.TXT?

Setelah anda membaca semua informasi yang ada di atas, Anda mungkin memiliki pemahaman tentang robots.txt dan mengapa kita harus memakainya untuk website WordPress. Kendala yang sangat berlebihan terhadap perilaku mesin pencari ‘akan memiliki dampak yang negatif pada urusan SEO sementara adanya kebebasan yang terlalu banyak dapat dalam crawl pada SE akan menempatkan website dalam bahaya.

Oleh sebab itu, Anda harus menentukan solusi yang bisa memberikan pertimbangan dalam pemakaian file robots.txt untuk keamanan website dalam urusan SEO. Berikut ini, adalah contoh cara membuat file robots.txt anda bisa membatasi perilaku mesin pencari dalam menjelajahi dan mengindeks.

Pertama, login ke dalam control panel hosting milik Anda, misalnya, cPanel. Cari file manager terbuka pada direktori file selain Backup. Setelah itu, Anda akan melihat file-file website Anda seperti file Robots.txt yang kita cari. Namun, jika anda tidak menemukan file itu, maka buat file yang baru serta beri nama Robots.txt , atau anda dapat membaca cara membuat file baru di cpanel terlebih dahulu.

Lalu, Anda klik kanan pada file Robots.txt dan klik pada pilihan kode sunting setelah pembukaan. Kemudian, anda pilih utf-8 sebagai pengkodean karakter serta klik edit. Setelah itu, anda copy dan paste kode berikut ini ke dalam file. Jangan lupa anda ganti tulisan xxx dengan domain milik anda anda.

[php]sitemap: http://www.xxx.com/sitemap.xml

User-agent: *

# disallow all files in these directories

Disallow: /wp-admin/

Disallow: /wp-includes/

Disallow: /cgi-bin/

Disallow: /wp-content/

Disallow: /archives/

Disallow: /*?*

Disallow: *?replytocom

Disallow: /author

Disallow: /comments/feed/

Disallow: */trackback/

Disallow: /wp-*

Disallow: /*?*

User-agent:Mediapartners-Google*

Allow:/

User-agent:Googlebot-Image

Allow:/wp-content/uploads/

User-agent:Adsbot-Google

Allow:/

User-agent:Googlebot-Mobile

Allow:/[/php]

Baca juga: CARA MEMBUAT FORUM TANYA JAWAB PADA WORDPRESS